L'inadeguatezza nell'era dell'AI: quando la perfezione artificiale ci rende insicuri

#AI

Viviamo in un’epoca paradossale: mai come oggi abbiamo avuto accesso a strumenti capaci di amplificare la nostra espressività creativa, eppure mai come oggi ci siamo percepiti così… inadeguati.

L’intelligenza artificiale, con i suoi output impeccabili, testi perfettamente strutturati, immagini visivamente seducenti e testi degni di un romanzo best seller (o quasi), sta progressivamente alterando la percezione di noi stessi.

Non solo ci indica come dovremmo comunicare o rappresentarci, ma si spinge a “migliorarci”, intervenendo sulle nostre fotografie, correggendo difetti, levigando imperfezioni, applicando quei filtri di perfezione che nessuna esperienza reale, per quanto autentica, potrà mai replicare.

Quando l’AI ci fa sentire meno bravi

Fino a qualche anno fa, completare una presentazione in PowerPoint che riuscisse a mantenere viva l’attenzione del pubblico era già motivo di grande soddisfazione. Oggi, invece, basta caricare un’idea su uno dei numerosi strumenti di AI per ottenere in pochi minuti un progetto grafico che sembra uscito da un’agenzia creativa di Manhattan. Il risultato? Non più soddisfazione, ma un senso di inadeguatezza latente: “Io non potrei mai creare qualcosa di simile“.

Analogamente, nel mondo della scrittura — che si tratti di articoli, saggi accademici, atti giudiziari o pareri legali — gli strumenti di AI generativa producono testi con una velocità e una correttezza grammaticale disarmanti. Dove prima riconoscevamo il nostro stile, magari imperfetto ma autentico, ora tendiamo a scorgere soltanto carenze, refusi e limiti da mascherare.

Confesso senza esitazione che anche io mi avvalgo di tool di intelligenza artificiale, che uso come correttori di bozze. Un tempo, in virtù della mia cronica e quasi maniacale ricerca di chiarezza espositiva, ero solita far rileggere i miei testi a una seconda persona, alla quale affidavo il compito di verificare la lucidità della forma e della sostanza che ritengo imprescindibili. Oggi quel “secondo lettore” ha, spesso, un’identità algoritmica.

Tuttavia, noto una tendenza crescente ad utilizzare l’AI non solo come supporto, ma come necessità psicologica di “chiedere approvazione” prima di esporsi: risposte a e-mail professionali, documenti di lavoro e persino commenti sui social network vengono redatti previa consultazione di strumenti di intelligenza artificiale generativa, come ChatGPT.

La paura di sbagliare, unita al timore di non risultare sufficientemente efficaci o brillanti, alimenta un impulso crescente a sottoporre ogni comunicazione a un controllo esterno, affidandosi a strumenti di AI non tanto per creare, quanto per validare. Ne consegue una domanda inevitabile: “Sarei stato in grado di redigere questo testo con pari efficacia e sicurezza, senza il conforto di una verifica algoritmica?“.

Quando l’AI ci fa sentire meno belli

E poi ci sono le immagini. L’elaborazione fotografica tramite strumenti di intelligenza artificiale è in grado di eliminare imperfezioni cutanee, ridefinire i lineamenti del volto (come la mascella o la simmetria degli occhi) e accentuare tratti estetici quali le ciglia o le proporzioni facciali, producendo risultati che richiamano la perfezione ideale (ideale per chi poi?). Guardando la versione “migliorata” di noi stessi, emerge spontaneamente — e non senza implicazioni psicologiche — una domanda cruciale: “Se questa è la versione migliorata di me stesso, quale valore riconosco alla mia immagine reale?“.

Il fenomeno ha ormai oltrepassato la dimensione strettamente individuale, assumendo una rilevanza sociale e culturale più ampia. Piattaforme digitali (come Instagram) sono state costrette a intervenire, disponendo la rimozione di alcuni filtri “bellezza” sviluppati dagli utenti, giudicati eccessivamente alteranti rispetto all’aspetto naturale dei volti. Tuttavia, permane un’evidente contraddizione: i filtri ufficiali forniti dalla piattaforma, pur perseguendo modifiche estetiche analoghe, sono rimasti disponibili, implicitamente veicolando l’idea che la ricerca della perfezione sia accettabile, a condizione che sia regolamentata e istituzionalmente “certificata”.

Inoltre, il mercato delle applicazioni digitali specificamente dedicate al “miglioramento estetico” ha conosciuto un’espansione esponenziale. Tali strumenti promettono di ridefinire i tratti somatici, modellare corporature più atletiche e conferire agli sguardi una maggiore intensità, aderendo a canoni estetici codificati. Tuttavia, l’uso massivo di queste tecnologie produce esiti progressivamente più innaturali e omologati, alimentando una dinamica ossessiva di auto-rappresentazione orientata verso un ideale di bellezza standardizzata e irraggiungibile, a discapito dell’autenticità individuale.

In tale contesto, un’osservazione personale risulta particolarmente rilevante: da diversi mesi sto sperimentando numerosi strumenti di elaborazione fotografica (alcuni esempi sono riportati in copertina) e ho rilevato una costante significativa. Indipendentemente dallo sviluppatore, tutti i software sembrano aderire rigidamente a parametri estetici standardizzati: proporzioni “ottimali” nella distanza oculare, incremento della carnosità labiale, modellazione della corporatura secondo criteri atletici e, per le donne, accentuazione volumetrica del seno. Questa omologazione algoritmica solleva interrogativi profondi: se l’intelligenza artificiale impone modelli predefiniti di bellezza, quale spazio resta per la molteplicità delle identità individuali? E soprattutto, quale rischio corriamo nell’impoverire la ricchezza e l’eterogeneità che costituiscono l’essenza stessa dell’umanità?

Paradossalmente, più inseguiamo l’ideale artificiale di bellezza, più ci allontaniamo dalla nostra identità reale, e più cresce il senso di inadeguatezza nei confronti di un’immagine che, per definizione, non potremo mai incarnare.

Dove ci sta portando tutto questo?

Il rischio principale di questo uso, sempre più diffuso e incontrollato, degli strumenti di intelligenza artificiale è l’erosione progressiva dell’autostima individuale e della fiducia nelle proprie capacità creative e personali. Se ogni nostra produzione è costantemente paragonata a quella di un’intelligenza artificiale che attinge a miliardi di esempi preesistenti, il senso di inadeguatezza diventa inevitabile.

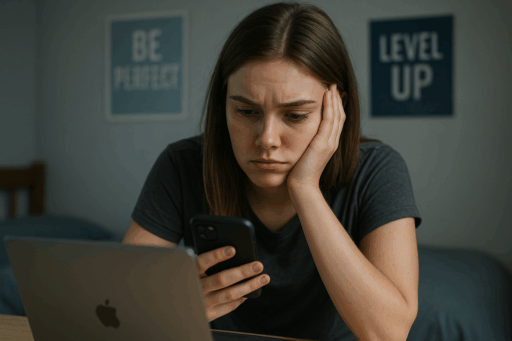

Questa dinamica, già preoccupante per gli adulti, risulta ancor più critica per gli adolescenti, i quali maneggiano tali strumenti con una consapevolezza ancora parziale dei meccanismi cognitivi ed emotivi coinvolti. Esposti precocemente a standard artificiali di perfezione estetica e produttiva, i nostri ragazzi e ragazze rischiano di interiorizzare modelli irrealistici e di sviluppare un senso di inadeguatezza cronica, con potenziali ripercussioni sullo sviluppo della propria identità personale e sociale.

A livello sociale, potremmo assistere a una nuova forma di “ansia da prestazione algoritmica“ caratterizzata dalla paura di non risultare adeguati non soltanto rispetto agli standard umani, ma anche rispetto a quelli imposti dalle macchine. In altri termini, si configura un nuovo tipo di perfezionismo digitale, ancora più insidioso in quanto inaccessibile.

La riflessione necessaria, dunque, è questa: vogliamo davvero accettare di misurarci quotidianamente con uno standard inumano? Oppure possiamo (e dobbiamo) rivendicare il valore dell’imperfezione, dell’errore, della creazione autentica, che da sempre costituiscono l’essenza stessa della nostra umanità?

Del resto, per quanto avanzata possa essere, l’intelligenza artificiale non potrà mai replicare quell’irregolarità unica e irripetibile che contraddistingue l’essere umano. E, paradossalmente, è proprio questa fragile, sfuggente imperfezione a renderci… perfetti.